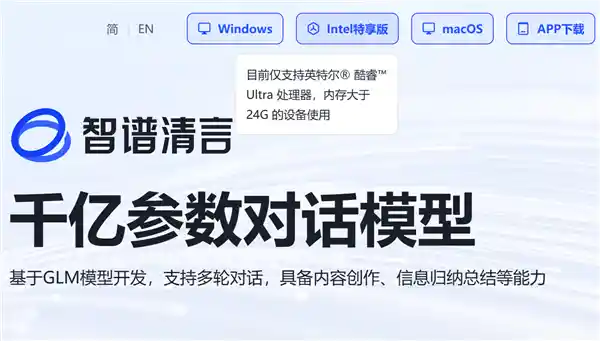

内存需求破纪录!智谱清言酷睿Ultra专享版震撼发布,离线畅享体验全面升级!

科技快讯中文网

12月18日,国内知名大模型企业智谱正式推出了智谱清言的Intel酷睿Ultra专享版本。这一新版本的最大亮点在于用户可以在不连接互联网的情况下,在个人电脑上进行本地化运行,从而确保了模型在端侧的应用,这不仅提升了用户体验,还有效保障了用户的数据隐私与安全。 从这个角度来看,智谱此举无疑是对当前AI应用领域中隐私保护需求的一种积极响应。随着技术的发展,用户对于个人信息安全的关注日益增加,而智谱清言的这一创新举措,既满足了用户对于高效便捷服务的需求,同时也兼顾了对隐私保护的重视。这对于推动整个行业向着更加健康、可持续的方向发展具有积极意义。

智谱清言作为一款覆盖移动端与PC端的AI助手,其附加功能十分丰富,不过在此之前,它一直需要借助云端的大模型来运行。 在我看来,智谱清言的这一特性虽然在一定程度上限制了其使用场景,但也显示出其对强大计算能力的需求。随着技术的发展,未来可能能够实现本地化的高效运算,届时,这款AI助手的应用范围将进一步扩大,用户体验也将得到显著提升。同时,这也提醒我们,在享受AI带来的便利时,对于基础设施的依赖也是一个不容忽视的问题。

酷睿Ultra系列处理器通过CPU+NPU+iGPU三者合作,可以为不同的AI负载提供合适的算力引擎,其中CPU适合对延迟要求较高的AI应用,NPU适合持续性的、低负载的AI应用,iGPU适合大吞吐量的AI运算。

智谱与Intel的合作在本地模型的选择上达到了模型参数与准确性的良好平衡,同时运用了合理的量化技术,确保了模型文件尺寸适中,并在性能调优方面采用了优秀的工具链,以保证模型在酷睿Ultra处理器上的高效运行。 这种合作不仅展示了技术融合的可能性,也为未来AI应用的发展提供了新的思路。通过选择合适的模型参数和准确性之间的平衡点,以及合理运用量化技术,可以有效控制模型文件的大小,这对于提高计算效率和降低存储成本具有重要意义。此外,借助优秀的工具链进行性能优化,能够显著提升模型在特定硬件平台上的运行效率,为用户带来更流畅的使用体验。这样的合作模式值得其他企业和研究机构借鉴,以促进AI技术更加广泛和深入的应用。

本次发布的智谱清言酷睿Ultra专享版,会自动检测PC配置,自动下载合适的端侧模型,提供知识问答、文档撰写、创意生成等服务。

比如,可以将若干篇存放在本地PC的文档通过RAG(检索增强生成)技术构建一个专属的知识库,这样可以通过自然语言进行查询,输出内容不仅能够包含来自本地文档的专业信息,而且表达方式会更加自然、更具逻辑性。 利用本地文档创建这样一个知识库,不仅可以帮助用户高效地获取所需信息,还能确保这些信息的准确性和权威性。特别是在当前信息爆炸的时代,人们每天都会接触到海量的信息,但真正有价值、可靠的信息却相对稀缺。这种基于RAG的知识库构建方式,为用户提供了一个快速筛选和获取高质量信息的有效途径。此外,这种方式还可以根据不同用户的特定需求进行定制化服务,进一步提升了信息获取的效率和质量。因此,这一技术的应用前景十分广阔,尤其适合需要频繁查阅相关资料的专业人士使用。

再比如,可以利用本地工具完成长文档的摘要工作,从而提升生产效率。 在当今信息爆炸的时代,高效处理大量文本资料变得尤为重要。通过使用高效的本地工具来生成文档摘要,不仅可以显著减少编辑和整理文档所需的时间,还能确保核心信息不被遗漏。这种方法不仅适用于科研工作者,同样也适合记者和撰稿人等需要频繁处理大量文字材料的专业人士。通过这种方式,我们能够更快速地获取到关键信息,提高工作效率,更好地应对快节奏的工作环境。此外,随着人工智能技术的发展,这些工具的功能将会越来越强大,为我们提供更多便利。

不过注意,它对内存容量也有一定的要求,不得低于24GB。

下载地址:

https://sfile.chatglm.cn/apk/xinyu/windows/endside/chatglm_setup_win32_1.0.81_default_full.exe

免责声明:本站所有文章来源于网络或投稿,如果任何问题,请联系648751016@qq.com

页面执行时间0.010507秒