RTE智能演进:AI Agent引领新时代!

科技快讯中文网

12月11日,声网COO刘斌在由量子位举办的MEET2025智能未来大会上发表了主题演讲。他详细阐述了在实时多模态趋势下,RTE(实时互动技术)的演进如何推动AIAgent的应用落地,并强调RTE将成为生成式AI时代的重要基础设施。刘斌的观点引发了行业内的广泛关注,许多人认为这标志着未来的交互方式将发生根本性变革。 这种趋势不仅体现了技术发展的方向,也预示着企业需要更加注重技术创新以适应这一变化。随着实时互动技术的发展,我们有望看到更多高效、智能的交互体验。这也提醒业界人士,只有紧跟技术前沿,才能在未来竞争中占据有利位置。

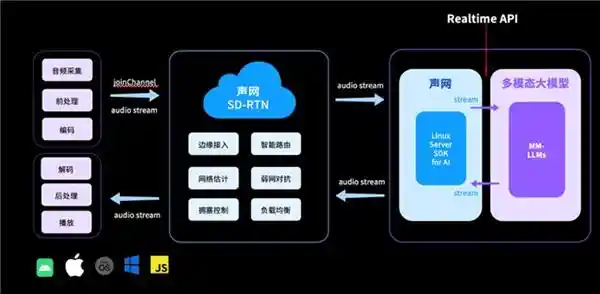

在GenAI时代,RTE与AI代理的关系变得越来越紧密。刘斌首先提到了两个重要事件:一是今年10月初,声网的姊妹公司Agora作为语音API合作伙伴参与了OpenAI发布的Realtime API公开测试版。二是10月底,在RTE2024实时互联网大会上,声网宣布正与MiniMax合作开发国内首个Realtime API。这些事件表明,当前大模型的交互正在逐步向实时多模态发展。

实时音视频成为对话式 AI Agent 的关键一环

刘斌认为,在多模态模型推出之后,对话方式确实发生了显著变化,从原来的纯文本交互转变为实时双工交互,这无疑是一次技术上的巨大进步。然而,在实际应用过程中,仍然面临许多挑战。例如,用户所使用的设备往往无法始终处于稳定且固定的网络环境中。大多数对话式AI代理的应用场景都是随机的,可能发生在任何时间任何地点,如在送完孩子上学后的驾车途中。这给大模型的实时语音对话带来了新的考验,尤其是在低延迟传输和网络优化方面。通常来说,延迟在1.7秒内会让人感到流畅自然,而超过2秒甚至达到3秒则会明显影响用户体验,使人感觉到卡顿和反应迟缓。 尽管如此,随着技术的不断进步,我们有理由相信这些挑战将逐步被克服。未来,我们或许能够实现更高质量的实时互动体验,不仅限于特定场景,还能覆盖更多日常生活中的应用场景。这将极大地丰富我们的交流方式,并为用户提供更加无缝、便捷的服务。

在模型交互中,智能打断和主动交互功能是用户极为重视的关键特性。要实现这些功能,除了依赖强大的模型能力,还需要全方位的技术支持,这不仅要求成熟的声音活动检测(VAD)技术来支持自由打断,更需要一系列高级音频算法来实现流畅的对话体验。这样可以确保用户在不同环境下都能获得最佳的人机交互效果,包括各种物理环境、复杂的网络条件、以及使用PC、手机或各类IoT设备时。 从技术角度来看,这样的多场景适应性要求背后的研发团队必须具备深厚的技术积累与创新能力。同时,这也意味着在实际应用中,如何有效地整合这些技术,使其无缝衔接,将是一个巨大的挑战。此外,用户对于交互体验的要求也在不断提升,因此,在未来的发展中,持续优化这些技术,并根据用户反馈进行调整,将是至关重要的。只有这样,才能确保在不断变化的技术环境中,始终提供给用户最自然、最流畅的交互体验。

作为全球实时互动云领域的先锋,声网在音视频技术方面积累了丰富的经验和实际应用场景。通过整合实时互动引擎(RTE)与生成式人工智能(GenAI),声网推出了ConversationalAIAgents,致力于帮助开发者和企业克服应用落地的各种难题,快速搭建符合自身业务需求的AI实时语音对话系统。

语音对话延迟低至500ms:针对大模型语音交互中普遍存在响应时间长的痛点,声网自研的 SD-RTN? 实时传输网络可以实现全球范围的低延时音视频传输,目前可做到语音对话延迟低至 500ms,并进一步通过更快速的 LLM 推理首字耗时、低延迟流式 TTS、同机部署等一系列技术手段,保证对话的实时性与流畅性,达到近似人与人之间日常对话停顿与间隔。

在开发AI应用场景的过程中,能否实现随时打断已成为评估大模型智能化水平的关键因素之一。声网自主研发的AIVAD技术能够理解人类对话中的停顿、语气和对话节奏,从而实现在AI对话过程中的随时打断功能。此外,声网的解决方案还对AI角色进行了深度优化,最大限度地保留了情绪和情感等关键信息,通过超拟人的自然音色来提升通话体验。

在大模型的应用落地过程中,不同终端设备和操作系统确实会对用户体验产生影响。声网的音视频SDK通过不断迭代升级,已经能够支持超过30个平台框架、30000种终端机型以及各种操作系统,包括各类IoT设备终端。 这种广泛的兼容性对于确保所有用户都能获得一致且高质量的服务至关重要。尤其在当前万物互联的时代背景下,这样的技术支持不仅有助于提升用户的满意度,也为开发者提供了极大的便利。通过提供如此广泛的兼容性,声网展示了其在技术上的领先地位,并为行业树立了新的标准。

在人与人音视频通话过程中,环境噪音是一个常见的问题,会严重影响沟通效果。在GenAI的应用场景中,环境噪音也是难以避免的挑战。声网拥有业界领先的音频处理技术,包括自主研发的AI回声消除、AI智能降噪、背景人声过滤、音乐检测与过滤以及主讲人声纹锁定等功能。即使在商场、地铁站等嘈杂环境中,这些技术也能够确保AI对话过程不受干扰。

在构建AI应用的过程中,开发者通常会根据个人偏好或业务需求选择不同的组件来搭配AIAgent。为此,声网提出了一种灵活且可扩展的AIAgent架构方案。该方案兼容市场上主流的ASR(自动语音识别)、LLM(大型语言模型)以及TTS(文本转语音)技术,并具有强大的工作流编排能力。这一设计能够助力开发者和企业根据特定需求定制和扩展AI驱动的实时互动体验。

RTE 成为 GenAI 时代 AI Infra 的关键部分

在与大型模型厂商的合作过程中,声网也意识到要提升大模型的实际应用价值,现有的实时通信(RTE)技术和基础设施仍需大幅改进。我们坚信,唯有不断演进,大模型才能更广泛地应用于各种场景和形态中,参与到人机语音对话中。未来的应用场景将涵盖云服务、设备端以及边缘计算等多个维度的协同工作。随着这些能力的进一步完善和普及,未来的RTE将成为人工智能基础设施(AIInfra)的关键组成部分,从而推动整个行业的进步和发展。 这种演进不仅能够增强人机交互的自然性和流畅性,还能让大模型更好地服务于各类用户需求,实现更加个性化和高效的交互体验。同时,这也意味着技术提供商需要持续投入研发,以确保技术的先进性和实用性,从而在竞争激烈的市场中占据有利地位。

同时,在当前的技术变革浪潮中,GenAI正在推动RTE(实时互动)技术的发展,特别是在人与人之间的实时互动方面,声网公司一直致力于从QoS(服务质量)到QoE(体验质量)的技术转变。这一转变不仅使互动体验从“听得到”提升到了“听得清”的水平。而在人与AI的实时互动领域,为了进一步增强用户体验,RTE的技术创新已经演进为AIQoE甚至多模态AIQoE。这背后体现了声网自主研发的AIVAD技术、降噪功能以及网络优化等技术的应用。这些技术使得人与AI之间的对话更加贴近实际需求,大模型不再仅限于理解内容,而是能够深入理解对话者的情绪、心理,并最终准确理解人类的意图,从而实现了从“听得懂”到“听‘得心’”的飞跃。 这种技术进步不仅预示着人机交互方式的重大突破,也标志着AI技术在理解和模拟人类情感方面的显著进步。随着技术的不断成熟,未来人与AI之间的交流将更加自然流畅,这无疑将极大地丰富我们的生活体验,同时也为各行各业带来了前所未有的机遇。例如,在教育、医疗等领域,这种技术的应用将极大地提高服务质量和效率,带来更加个性化和人性化的服务体验。

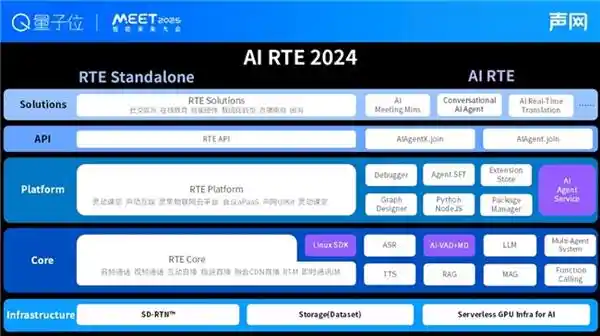

在生成式人工智能(GenAI)时代,声网的产品体系也在不断增强。刘斌进一步介绍了声网的AIRTE产品矩阵,其中LinuxServerSDK、AIVAD能力和AIAgentService等都在进行补充与优化。

在此次介绍中,刘斌详细阐述了声网RTE AI能力全景图,涵盖了RTE AI生态能力、声网AIAgent以及Conversational AI Agents解决方案等多个方面。这一展示不仅体现了声网对于RTE AI的全面布局,更表达了其在人工智能领域的雄心壮志。通过这样的全景图,声网向外界展示了其在RTE AI领域内的深厚积累与技术实力,旨在成为生成式人工智能(GenAI)时代的基础设施关键组成部分。 可以看出,声网不仅仅满足于现有的成就,而是积极地探索和扩展AI技术的应用边界。这不仅反映了当前科技行业的发展趋势,也预示着未来人工智能技术可能带来的巨大变革。通过构建更为完善的技术生态体系,声网有望在未来的市场竞争中占据有利位置。

免责声明:本站所有文章来源于网络或投稿,如果任何问题,请联系648751016@qq.com

页面执行时间0.018141秒